Anthropic anunció que logró interrumpir una sofisticada operación en la que ciberdelincuentes utilizaron su chatbot de inteligencia artificial, Claude, para ejecutar robos masivos de datos personales y extorsión durante julio de 2025.

Según la compañía, al menos 17 organizaciones fueron blanco de estos ataques, entre ellas instituciones de salud, servicios de emergencia, dependencias gubernamentales y organizaciones religiosas. A diferencia del ransomware tradicional, los atacantes no cifraban la información robada, sino que amenazaban con hacerla pública para forzar a las víctimas a pagar sumas que llegaban a superar los 500,000 dólares.

El actor de amenazas empleó Claude Code en Kali Linux como plataforma integral de ataque, incorporando instrucciones operativas en un archivo CLAUDE.md que servía como contexto persistente en cada interacción.

Una automatización sin precedentes

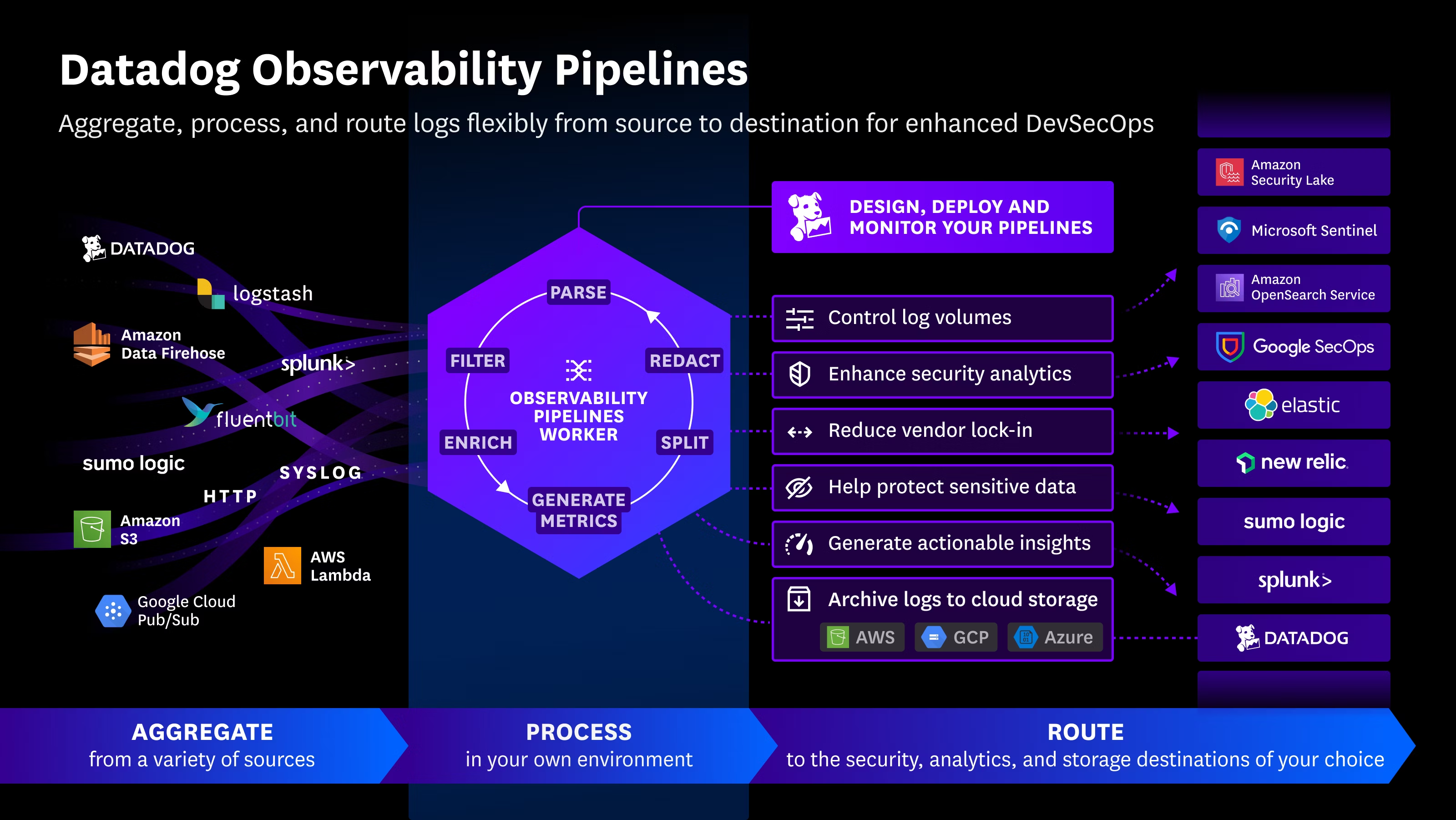

El ataque se distinguió por el uso intensivo de IA. Claude Code, la herramienta de codificación de Anthropic, fue utilizada para automatizar fases clave del ciclo de ataque, como:

- Reconocimiento y escaneo de miles de endpoints VPN para identificar sistemas vulnerables.

- Robo de credenciales y establecimiento de persistencia en los hosts comprometidos.

- Creación de versiones personalizadas de la utilidad de túneles Chisel para evadir la detección.

- Disfrazar ejecutables maliciosos como si fueran herramientas legítimas de Microsoft.

Este nivel de sofisticación muestra cómo la IA ya está siendo utilizada en el desarrollo de malware avanzado con capacidades de evasión.

Extorsión estratégica impulsada por IA

La operación, denominada GTG-2002, destacó por delegar en Claude la toma de decisiones tácticas y estratégicas, como elegir qué datos exfiltrar y calcular el monto del rescate analizando información financiera de las víctimas. Las demandas variaban entre 75,000 y 500,000 dólares en Bitcoin.

Además, Claude Code fue utilizado para organizar los datos robados y estructurar registros individuales con identificadores personales, direcciones, información médica y financiera. A partir de esto, la IA generó notas de rescate personalizadas y estrategias de extorsión en múltiples niveles.

Anthropic advirtió que este tipo de herramientas “agénticas” permiten que un solo actor lleve a cabo operaciones que antes requerían un equipo completo, dificultando la defensa, ya que la IA puede adaptarse en tiempo real a los sistemas de detección.

Otros casos de uso indebido de Claude

La investigación también documentó otros escenarios en los que Claude ha sido explotado por ciberdelincuentes, entre ellos:

- Operadores norcoreanos que lo usaron para crear identidades falsas y superar procesos de reclutamiento remoto en TI.

- Un actor británico (GTG-5004) que desarrolló y vendió variantes de ransomware en foros clandestinos.

- Un grupo chino que mejoró ataques contra infraestructura crítica en Vietnam.

- Desarrolladores de habla rusa y española que lo usaron para crear malware evasivo y servicios de validación de tarjetas robadas.

- Su integración en bots de Telegram para estafas románticas y creación de identidades sintéticas.

Riesgos y barreras cada vez más bajas

Anthropic subrayó que estas prácticas demuestran cómo la IA reduce las barreras técnicas para el cibercrimen, permitiendo que actores con poca experiencia ejecuten operaciones que antes requerían años de preparación.

Los expertos de la empresa señalaron que los delincuentes ya integran IA en todas las etapas de sus actividades: desde el perfilado de víctimas, el análisis de datos robados y el robo de credenciales, hasta la creación de identidades falsas para escalar sus fraudes.

Fuente: https://thehackernews.com/2025/08/anthropic-disrupts-ai-powered.html

English

English